آیا میدانستید که پیشرفتهای باورنکردنی هوش مصنوعی که شاهد آن هستیم، هزینهای پنهان و عظیم دارد؟ 💡 در سالهای اخیر، هوش مصنوعی با سرعتی فراتر از هر فناوری دیگری در تاریخ معاصر منفجر شده است. آنچه زمانی آزمایشهایی بیسروصدا در آزمایشگاههای دانشگاهی بود، اکنون به عملیاتهایی در مقیاس قارهای تبدیل شده که در مراکز داده عظیم جای گرفتهاند.

این نیروگاههای هوش مصنوعی بر پایهی یک دستورالعمل ساده اما بسیار پرتقاضا کار میکنند: تراشههای قدرتمند، حجم عظیمی از داده، و منبعی روزافزون از برق. از میان این سه، برق به گلوگاه نهایی تبدیل شده است. در حالی که هر نسل جدید از مدلهای هوش مصنوعی، بهرهوری بهتری در سطح تراشه ارائه میدهد، مقیاس محض هوش مصنوعی مدرن—با مجموعه دادههای بزرگتر، زمانهای آموزش طولانیتر و پارامترهای پیچیدهتر—مصرف کل انرژی را به سطوح سرسامآور جدیدی میرساند.

گفتمان در حال تغییر است. جهش بعدی در هوش مصنوعی نه توسط کسی که سریعترین کامپیوتر را دارد، بلکه توسط کسی که بتواند قدرت کافی برای راهاندازی آن را تأمین کند، رقم خواهد خورد. این مرز جدید پیشرفت هوش مصنوعی است. 🔋

مقیاس تکاندهندهی اشتهای انرژی هوش مصنوعی

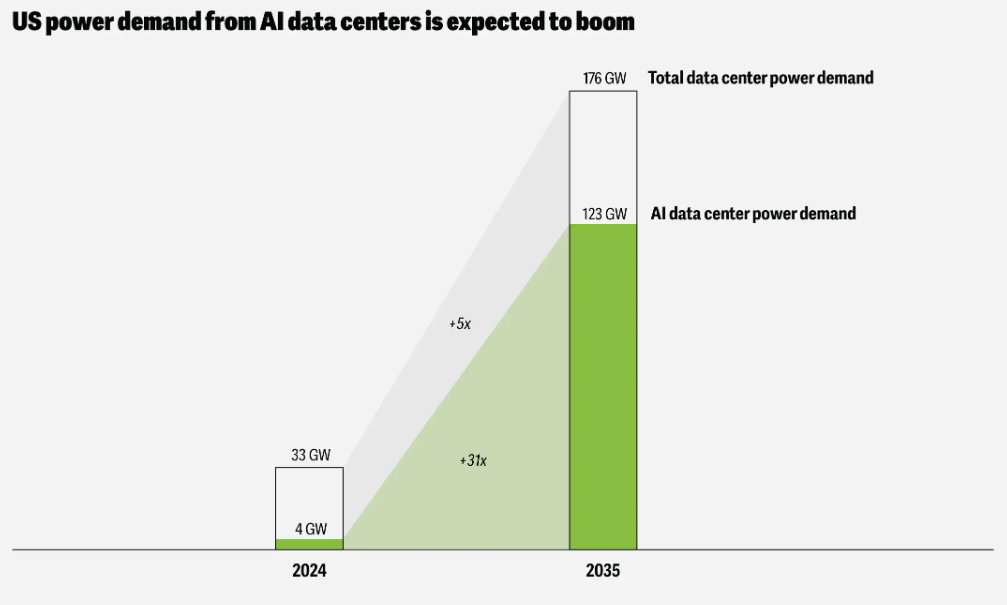

اعداد و ارقام حیرتانگیز هستند. آژانس بینالمللی انرژی (IEA) تخمین زده است که در سال ۲۰۲۴، مراکز داده در سراسر جهان حدود ۴۱۵ تراوات-ساعت (TWh) برق مصرف کردهاند. پیشبینی میشود تا سال ۲۰۳۰، این رقم تقریباً دو برابر شده و به ۹۴۵ تراوات-ساعت برسد. فاتح بیرول، مدیر اجرایی IEA، هوش مصنوعی را «یکی از بزرگترین داستانهای امروز در حوزه انرژی» مینامد و هشدار میدهد که تقاضای برق از سوی مراکز داده به زودی میتواند با مصرف کل کشورها رقابت کند.

این تقاضای سیریناپذیر در حال تغییر شکل زیرساختهای جهانی است. غولهای فناوری دیگر فقط به دنبال اتصالات شبکهای سریع نیستند؛ آنها در یک جستجوی جهانی برای شبکههای برق پایدار، برق ارزان و فضا برای پروژههای انرژی تجدیدپذیر هستند. تنها در ایالات متحده، انتظار میرود مصرف مراکز داده تا پایان دهه به نزدیک ۸۰۰ تراوات-ساعت برسد، البته به شرطی که زیرساختهای لازم به موقع ساخته شوند. در دسترس بودن برق اکنون تعیینکننده مکانی است که خوشه بزرگ بعدی هوش مصنوعی در آن ساخته خواهد شد و این امر برنامهریزی انرژی را به یک مذاکره استراتژیک بین شرکتهای فناوری و شرکتهای برق تبدیل کرده است.

چرا هوش مصنوعی این همه برق مصرف میکند؟

در قلب هوش مصنوعی، محاسبات محض قرار دارد. پردازندههای گرافیکی تخصصی (GPU) که مدلهای بزرگ را آموزش میدهند و اجرا میکنند، در هر ثانیه تریلیونها محاسبه انجام میدهند و انرژی عظیمی مصرف میکنند که تقریباً به طور کامل به گرما تبدیل میشود. یک درخواست متنی ساده به مدلی مانند Gemini گوگل میتواند ۰.۲۴ وات-ساعت برق مصرف کند. این عدد را در میلیونها کاربر روزانه ضرب کنید تا مقیاس آن مشخص شود.

این گرما باید به طور مداوم توسط سیستمهای خنککننده پرمصرف مدیریت شود. یک رک از شتابدهندههای مدرن هوش مصنوعی میتواند ۳۰ تا ۵۰ کیلووات برق مصرف کند—چندین برابر سرورهای قدیمی. برخلاف بارهای کاری محاسباتی سنتی که نوسان داشتند، سیستمهای هوش مصنوعی اغلب برای هفتهها با ظرفیت نزدیک به حداکثر کار میکنند و فشار بیوقفهای بر شبکه برق و زیرساختهای خنککننده وارد میکنند. بهرهوری انرژی دیگر یک موضوع حاشیهای نیست؛ بلکه سنگ بنای هوش مصنوعی مقیاسپذیر است.

پارادوکس عملکرد به ازای هر وات

سازندگان تراشه مانند انویدیا و AMD در یک رقابت دائمی برای بهبود عملکرد و بهرهوری هستند. با این حال، یک پارادوکس عجیب پدیدار شده است: دستاوردهای بهرهوری در سطح تراشه به طور کامل تحتالشعاع رشد انفجاری مصرف انرژی کل سیستم قرار گرفته است. هر پیشرفت در فناوری تراشه، مدلهای هوش مصنوعی بزرگتر و آموزشهای فشردهتری را به دنبال دارد و عملاً هرگونه صرفهجویی را از بین میبرد.

این امر چالش را از یک مسئله طراحی پردازنده به یک پازل مهندسی در مقیاس عظیم تبدیل کرده است. مراکز داده در حال بازطراحیهای رادیکال هستند، از خنککنندههای هوایی به مایع روی آورده و پستهای برق خود را فقط برای همگام شدن با این تقاضا ارتقا میدهند. دنیای فیزیکی سیمها، پمپها و شبکههای برق در تلاش است تا از خواستههای نمایی دنیای دیجیتال پشتیبانی کند.

سرعت به ازای توان: استاندارد طلایی جدید

یک معیار جدید در حال تسخیر بیسروصدای دنیای هوش مصنوعی است: سرعت به ازای توان (speed-to-power). تمرکز دیگر بر سرعت خام (فلاپس) نیست، بلکه بر این است که به ازای هر وات انرژی مصرفی، چقدر عملکرد میتوان به دست آورد. این توازن اکنون همه چیز را از طراحی تراشه تا قیمتگذاری خدمات ابری دیکته میکند. ارائهدهندگان خدمات ابری شروع به صدور صورتحساب بر اساس میزان مصرف برق کردهاند و توسعهدهندگان را مجبور میکنند کدهای خود را برای بهرهوری انرژی بهینه کنند.

وقتی یک مدل هوش مصنوعی میتواند به اندازه یک شهر کوچک برق مصرف کند، این بهرهوری اهمیت فوقالعادهای پیدا میکند. این عامل نادیدهای است که تعیین میکند چه کسی میتواند هوش مصنوعی را در مقیاس جهانی بسازد و اداره کند.

رقابت ژئوپلیتیکی برای برتری در هوش مصنوعی

همانطور که انرژی به محور اصلی هوش مصنوعی تبدیل میشود، پویایی قدرت جهانی در حال تغییر است. کشورهایی که بتوانند انرژی فراوان، قابل اعتماد و ارزانقیمت تأمین کنند، «مزیت استراتژیک برق» به دست خواهند آورد و موج بعدی رشد فناوری و صنعتی را رهبری خواهند کرد. 🌍

این امر نوع جدیدی از مسابقه تسلیحاتی را به راه انداخته است. دولتها در حال بررسی «قطبهای محاسباتی هستهای» هستند—مناطقی که راکتورهای هستهای کوچک ماژولار را در کنار مراکز داده فوقمقیاس قرار میدهند. چالش بسیار بزرگ است و بدون سرمایهگذاری سریع در منابع انرژی جدید و نوسازی شبکه برق، حتی کشورهای پیشرو نیز ممکن است با مشکلات قابلیت اطمینان مواجه شوند. سؤال دیگر فقط ساخت ماشینهای هوشمند نیست، بلکه این است که آیا دنیای فیزیکی ما میتواند آنها را پایدار نگه دارد.

سفر برای تأمین انرژی آینده هوش مصنوعی تازه آغاز شده است و شامل بازآفرینی سیستمهای انرژی، مراکز داده و حتی اولویتهای جهانی ما خواهد بود.

منبع: BigDATAwire